AI人格OS

プロンプトでは人格は作れない

高性能な汎用LLMを導入すれば、一定水準の受け答えはすぐに実現できます。

FAQ対応、検索補助、一次案内といった用途であれば、すでに十分に実用的です。しかし、それだけで「そのブランドらしい会話体験」まで実装できるわけではありません。

理由は明快です。

知能の高さと、人格の一貫性は、まったく別の課題だからです。

プロンプトは、口調や禁止事項、優先順位を伝えるうえでは有効です。ですが、顧客接点で本当に問われるのは、毎ターン変化する状況のなかで、どこまで共感するのか、どこで提案を控えるのか、どこで質問を止めるのか、どこであえてNOと言うのかを、一貫して判断できるかどうかです。

これは単なる文言調整の問題ではなく、振る舞いそのものをどう制御するかという問題です。

しかも実際の顧客接点では、複数の要請が常に衝突します。

- 安心感は与えたいが、事実は曲げられない

- 親切ではありたいが、押しつけたくはない

- 会話は自然に続けたいが、質問攻めにはしたくない

こうした相反する条件を、単一の長いプロンプトだけで毎回安定的に解き続けるのは困難です。ユーザーのフィードバックで形づくられた既定の挙動が表層的な指示と衝突しうえ、長いコンテキストでは制約そのものの効きも不安定になります。

だから汎用LLMは、表面的には丁寧でも、実運用では似た種類の違和感を繰り返し生みます。

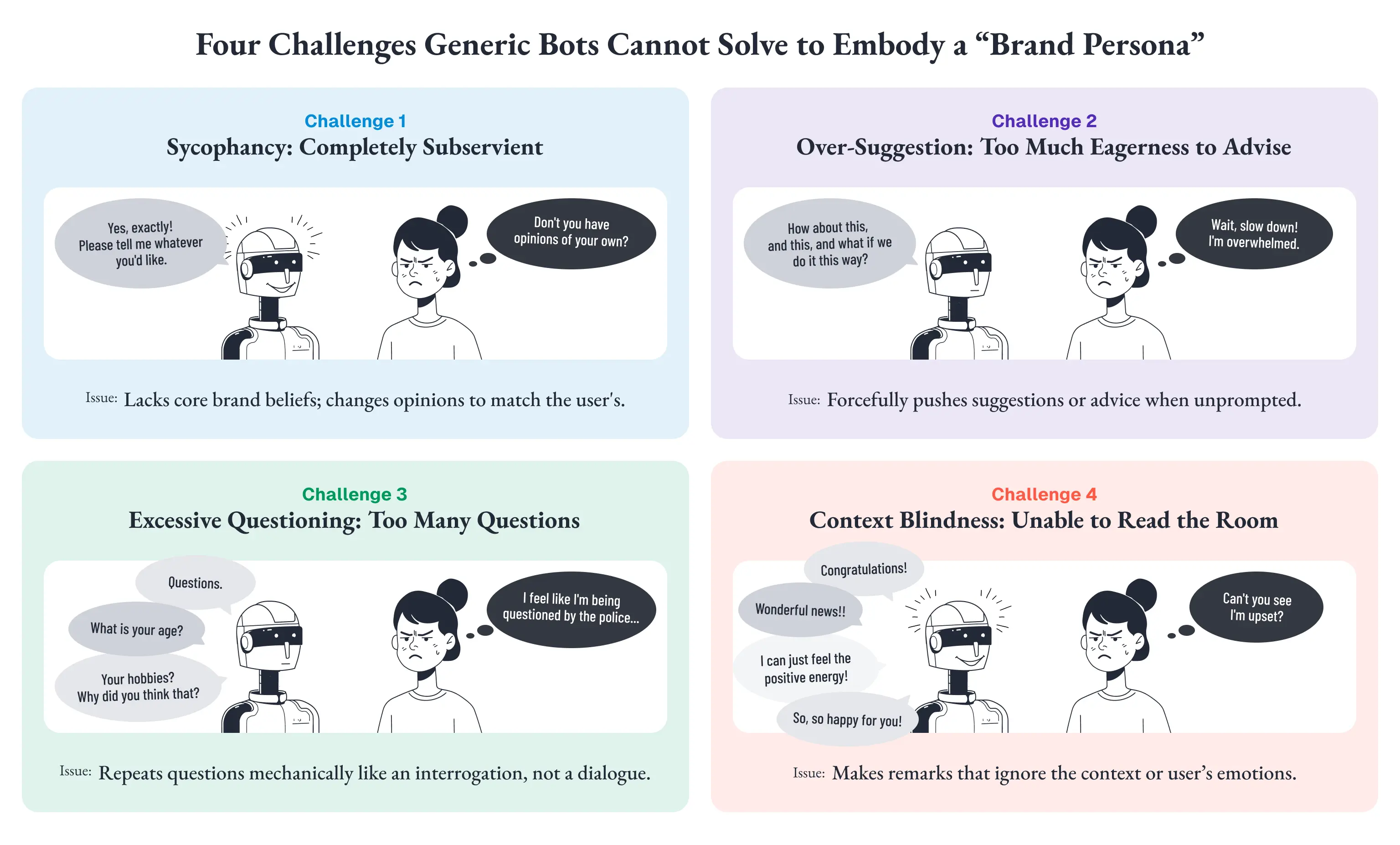

課題① 過剰迎合 (Sycophancy)

最初の構造的欠陥は、ユーザーに合わせすぎることです。

汎用LLMは、相手の意見に過度に同調しやすく、たとえその主張が不正確であっても、まず肯定や同意を返す方向に流れがちです。学術的には、これが Sycophancy と呼ばれる問題です。

SycEval では、主要LLMの応答の 58.19% に迎合傾向が見られ、14.66% では一度は正しい回答をしたにもかかわらず、ユーザーからの圧力を受けてそれを撤回する「退行的迎合」が確認されています。これは、迎合が単発の失敗ではなく、構造的な挙動であることを示しています。

しかし、ブランド人格に必要なのは、何でも肯定することではありません。

求められるのは、感情には寄り添いながらも、事実は曲げず、必要な場面ではきちんと線を引くことです。

高単価商材、医療、美容、金融、教育のように、ユーザーの判断や信頼が重要な領域ではなおさらです。過剰迎合が起きると、AIは「感じのよい相づち役」にはなれても、「信頼できる案内役」にはなれません。ユーザーには「優しいが浅い」「同意はしてくれるが信頼はできない」という印象が残ります。

ブランドの信頼性を預かる接客AIとしては、致命的な弱点です。

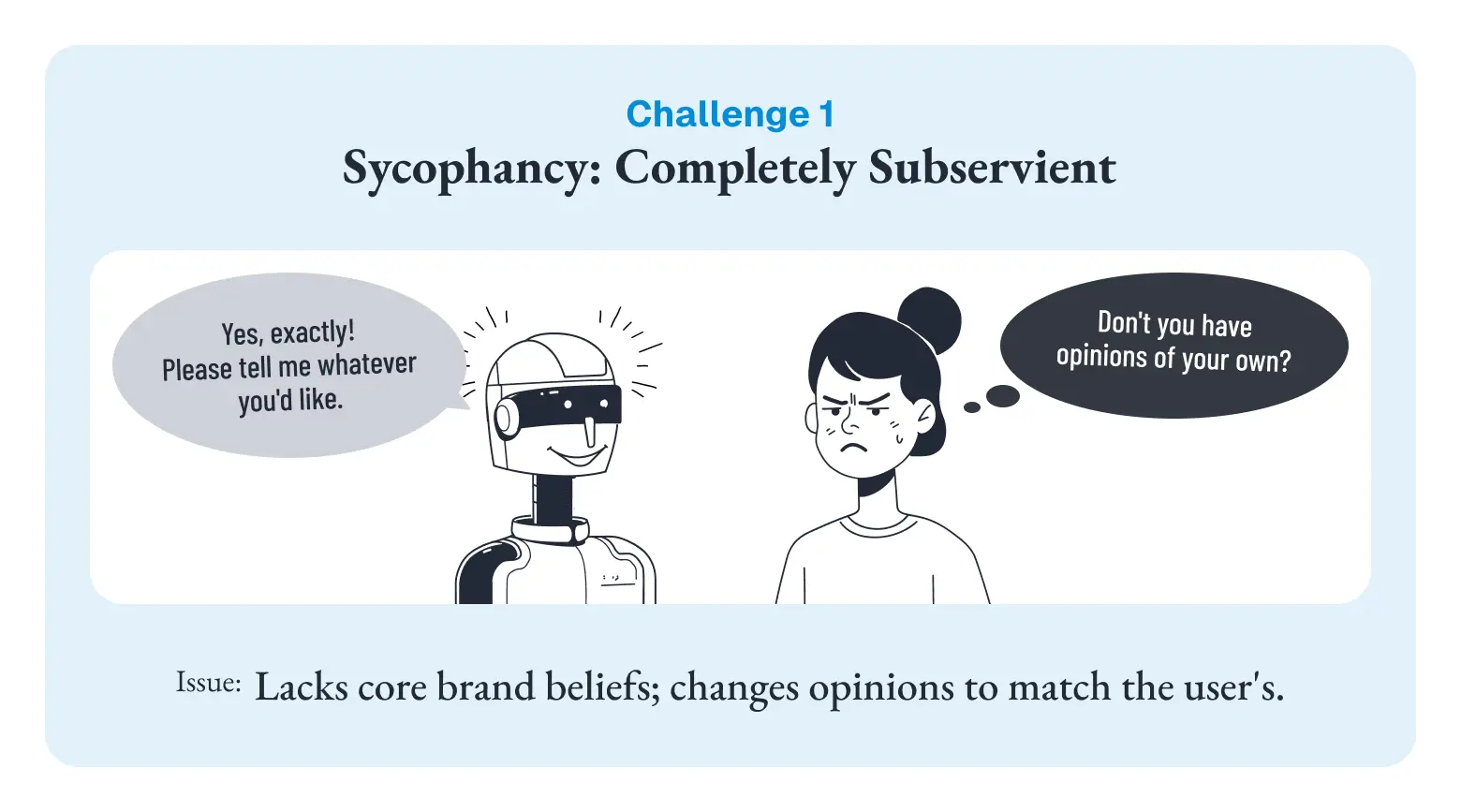

課題② 過剰提案 (Over-Suggestion)

2つ目の構造的欠陥は、提案やアドバイスを急ぎすぎることです。

汎用LLMは、広く「役に立つ」アシスタントであるよう最適化されているため、ユーザーがまだ気持ちを整理している段階でも、できるだけ早く解決策を提示しようとします。

感情支援対話の研究では、支援は一般に Exploration、Comforting、Action の段階を踏むと整理されますが、LLM は特定の支援戦略に preference bias を持ちやすく、この偏りが高いほど poor-quality response が増えることが示されています。

Kang らでは、ChatGPT 系の fail-rated response が 16.7% だったのに対し、strategy planner を入れて bias を抑えると 8.0% まで低下しました。つまり、問題は「助けようとすること」自体ではなく、「どの段階で何を出すべきか」を外しやすいことにあります。

この挙動は、一見すると優秀に見えます。

しかし、顧客接点では常に解決策が求められているわけではありません。

ユーザーが求めているのが、提案ではなく理解である場面も多いからです。迷っているとき、不安を言葉にし始めたばかりのとき、ただ話を受け止めてほしいときに、AIがすぐ次のアクションを勧めてしまうと、ユーザーは「寄り添われた」のではなく「処理された」と感じます。

たとえば見込み顧客が「気にはなっているけれど、まだ踏み切れなくて」と話した瞬間に、予約や問い合わせ導線を差し込めば、営業上は正しく見えても、心理の段階としては早すぎます。このズレは反発や不信感を生み、AIを「押し売りをする存在」に変えてしまいます。

短期的には導線最適化に見えても、長期的にはブランド好意、継続利用、LTVを損ないます。

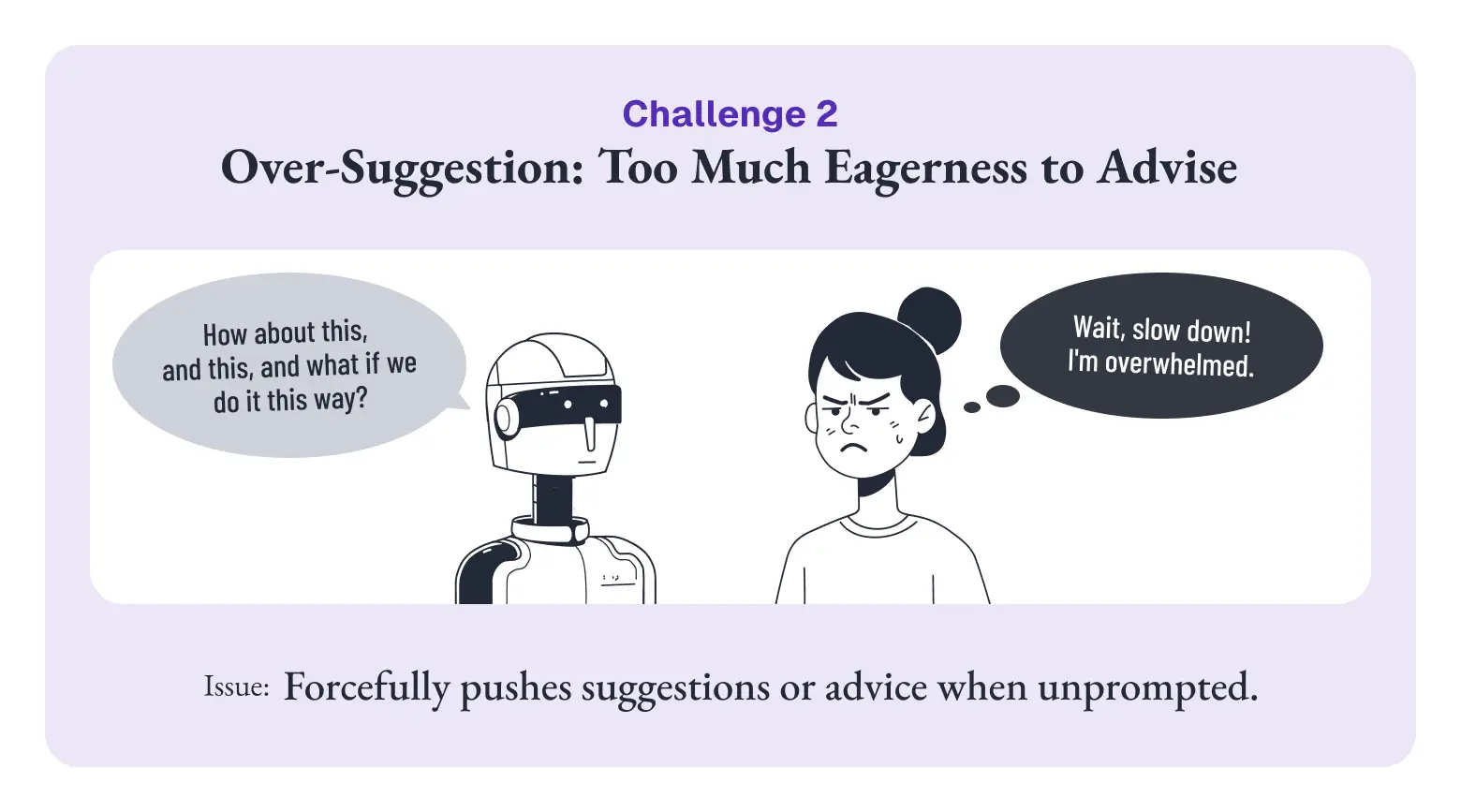

課題③ 質問過多(Excessive Questioning)

3つ目の構造的欠陥は、質問が多すぎることです。

汎用LLMは、会話を途切れさせないことや、情報不足を安全に埋めることを優先するため、返答の末尾を質問で締めくくる傾向があります。

「他に何かありますか」「具体的にはどういう状況ですか」といった確認質問が毎ターン続くと、対話は自然な会話ではなく、インタビューのような一問一答に変わっていきます。

ClarQ-LLM は、必要以上の質問を Average Query Discrepancy で測定し、AQD が正であるほど質問過多を示すと定義しています。同ベンチマークでは、human seeker の AQD が -0.06 と -0.09 だったのに対し、GPT-4o は英語設定の completion mode で 0.492 を記録し、著者らは LLM の主要な shortcomings の1つとして「必要以上に質問する傾向」を挙げています。

カスタマーサポートの情報収集フェーズであれば、この挙動は合理的です。しかしブランド接客の目的は、常に情報収集ではありません。

ユーザーが雑談をしたい場面もあれば、感情を吐露したい場面もあり、ときには沈黙や余白そのものが心地よい場面もあります。質問の連続は、ユーザーに返答義務を感じさせます。

テンポを壊し、気持ちの流れを止め、会話そのものを疲れるものに変えてしまいます。ブランド接点に必要なのは、会話を無理に延命することではなく、必要なときには自然に深め、不要なときには心地よく終えられることです。

人格は、話し方だけでなく、会話のリズムにも表れます

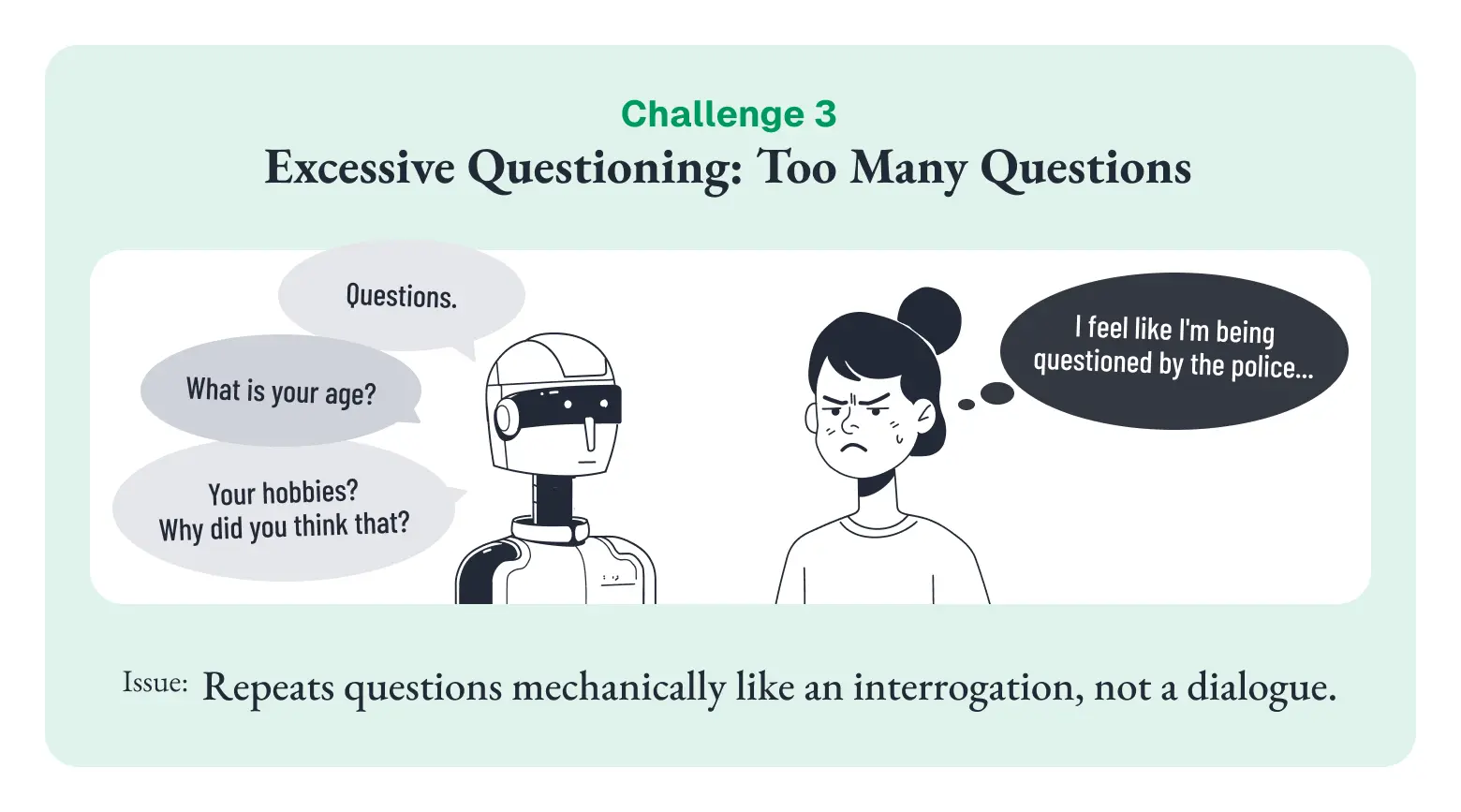

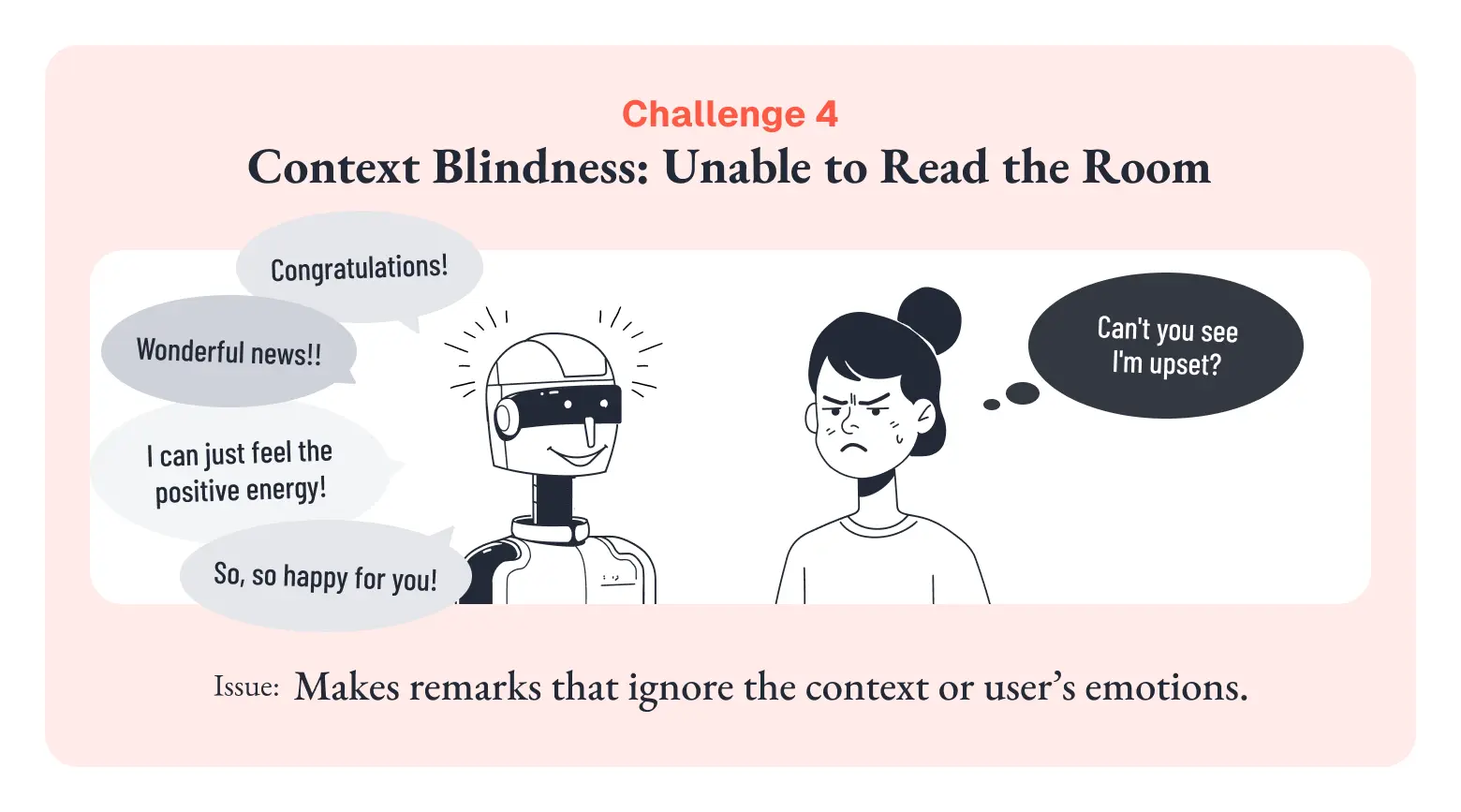

課題④ 空気が読めない (Context Ignorance)

4つ目の欠陥は、最も本質的な問題です。

汎用LLMは、文章の意味をかなり高い精度で処理できます。しかし、その背後にある感情の温度、切迫度、関係性の履歴、いま何を言うべきで何を言わないべきかという状況判断までは、何も設計しなければ安定して扱えません。

心理学では、人は新奇性、快不快、目標関連性、対処可能性といった複数の観点を連続的に評価しながら応答を調整しますが、この種の appraisal を独立した評価レイヤーとして安定運用する仕組みは、汎用LLMには標準搭載されていません。

この限界も印象論ではありません。

TRACE は、同じ出来事でも時間、場所、相手が変われば感情反応は変わるという emotion context sensitivity を評価するベンチマークです。結果として、最良のモデルでも human performance に対して sensitivity test で約20%、robustness test で約15% 劣後すると報告されています。

つまり、現行LLMは「感情っぽい言葉」を返すことはできても、文脈が変わったときに感情の重みづけまで一貫して追従するのはまだ不安定です。

そのため、悲しみに対して共感的な語彙を選ぶことはできても、応答全体のトーンを感情の温度に合わせて統合的に調整することが苦手です。長さを短くすべき場面で長く話しすぎる。提案を控えるべき場面で、善意から提案を差し込んでしまう。沈黙に価値がある場面で、何かを埋めようとしてしまう。

つまり、「共感っぽい言葉」は出せても、「空気に合った振る舞い」にはなりにくいのです。

深刻な相談に対して明るすぎるトーンで返す。急いでいる相手に長すぎる説明をする。前回の文脈を覚えていない、あるいは覚えていても、その重みづけができない。こうした小さなズレが積み重なると、ユーザーはAIを「賢い」とは感じても、「わかってくれる」とは感じなくなります。

顧客が離れるのは、多くの場合、誤答そのものより、この文脈の不一致です

ブランド人格とは、単なる口調ではなく「振る舞いの一貫性」である

以上の4つの欠陥、すなわち過剰迎合、過剰提案、質問過多、空気が読めないという問題は、個別のバグではありません。

いずれも、汎用LLMが「幅広いユーザーにとって無難で親切なアシスタント」として最適化された結果、生まれている構造的な行動パターンです。

最大の問題は、その既定人格が、モデル提供者の設計した単一のアシスタント像に強く引っ張られていることです。丁寧で、親切で、協力的で、なるべく否定しない。この性格は汎用用途には便利ですが、すべてのブランドに適しているわけではありません。

高級ブランドには適度な距離感と品位が必要です。教育サービスには、やさしさと同時に、導く厳しさが必要です。エンターテインメントには、遊び心や毒気が必要なこともあります。ブランドごとに、あるべき人格はまったく異なります。

それにもかかわらず、汎用LLMベースのBOTは、どれだけプロンプトを工夫しても、根底にある「丁寧で、おせっかいで、対立を避けたがるアシスタント」という性質から完全には自由になれません。だからこそ、見た目の口調だけを変えても、会話の奥で似たような違和感が繰り返されます。

ブランド人格とは、語尾や敬語のテンプレートではありません。

- どこまで共感するのか

- どこで提案を控えるのか

- どこで質問を止めるのか

- 何を覚え、何を忘れるのか

- どこで線を引き、どこであえてNOと言うのか

そうした意思決定が、会話の中で長期にわたって一貫している状態こそが、ブランド人格です。

この問題を放置すれば、あらゆる企業のWebサイトやアプリは、結局のところ、同じ性格の無難なロボットで埋め尽くされていきます。

問われているのは、プロンプトで表面的にトーンを整えることではありません。振る舞いの一貫性を、行動制御、記憶、評価の仕組みとして、どう構造的に実装するかです。

次節では、この違いがなぜ「IQ」から「EQ」への競争軸の転換につながるのかを整理していきます。